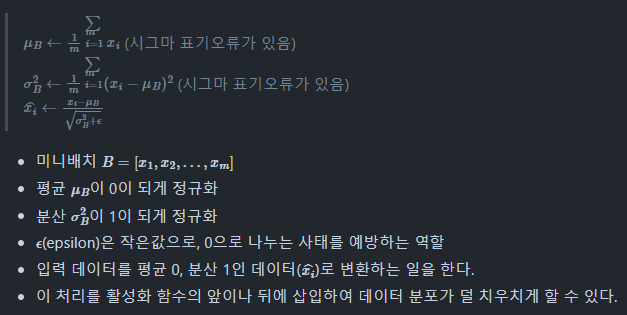

- 배치 정규화(Batch Normalization): 각 층에서의 활성화값이 적당히 분포되도록 조정하는 것 배치 정규화 알고리즘- 배치 정규화는 학습 시 데이터 분포가 평균이 0, 분산이 1이 되도록 미니배치를 단위로 정규화한다.배치 정규화의 장점1. 학습을 빨리 진행할 수 있다.(학습 속도 개선) 2. 초깃값에 크게 의존하지 않는다. 3. 오버피팅을 억제한다. (드롭아웃 등의 필요성 감소) MNIST 데이터셋을 사용한 배치 정규화 계층 사용에 따른 학습진도 차이- 실선이 배치 정규화를 사용한 경우 ,점선이 사용하지 않은 경우이다. - 거의 모든 경우에서 배치 정규화를 사용할 때의 학습 진도가 빠르다.