CNN 구현, 시각화

- 사진은 간단한 CNN 네트워크 예시로, Convolution-ReLU-Pooling-Affine-ReLU-Affine-Softmax 순으로 흐른다.

import sys, os

sys.path.append(os.pardir) # 부모 디렉터리의 파일을 가져올 수 있도록 설정

import pickle

import numpy as np

from collections import OrderedDict

from common.layers import *

from common.gradient import numerical_gradient

class SimpleConvNet:

def __init__(self, input_dim=(1, 28, 28),

conv_param={'filter_num':30, 'filter_size':5, 'pad':0, 'stride':1},

hidden_size=100, output_size=10, weight_init_std=0.01):

filter_num = conv_param['filter_num']

filter_size = conv_param['filter_size']

filter_pad = conv_param['pad']

filter_stride = conv_param['stride']

input_size = input_dim[1]

conv_output_size = (input_size - filter_size + 2*filter_pad) / filter_stride + 1

pool_output_size = int(filter_num * (conv_output_size/2) * (conv_output_size/2))

# 가중치 초기화

self.params = {}

self.params['W1'] = weight_init_std * \

np.random.randn(filter_num, input_dim[0], filter_size, filter_size)

self.params['b1'] = np.zeros(filter_num)

self.params['W2'] = weight_init_std * \

np.random.randn(pool_output_size, hidden_size)

self.params['b2'] = np.zeros(hidden_size)

self.params['W3'] = weight_init_std * \

np.random.randn(hidden_size, output_size)

self.params['b3'] = np.zeros(output_size)

# 계층 생성

self.layers = OrderedDict()

self.layers['Conv1'] = Convolution(self.params['W1'], self.params['b1'],

conv_param['stride'], conv_param['pad'])

self.layers['Relu1'] = Relu()

self.layers['Pool1'] = Pooling(pool_h=2, pool_w=2, stride=2)

self.layers['Affine1'] = Affine(self.params['W2'], self.params['b2'])

self.layers['Relu2'] = Relu()

self.layers['Affine2'] = Affine(self.params['W3'], self.params['b3'])

self.last_layer = SoftmaxWithLoss()학습에 필요한 매개변수는 1번째 층의 합성곱 계층과 나머지 두 완전연결 계층의 가중치와 편향이다.

SimpleConvNet초기화를 마친 후, 추론을 수행하는 predict와 손실함수값을 구하는 loss 구현

def predict(self, x):

for layer in self.layers.values():

x = layer.forward(x)

return x

def loss(self, x, t):

y = self.predict(x)

return self.last_layer.forward(y, t)

오차역전파법으로 기울기를 구하는 구현

def gradient(self, x, t):

# forward

self.loss(x, t)

# backward

dout = 1

dout = self.last_layer.backward(dout)

layers = list(self.layers.values())

layers.reverse()

for layer in layers:

dout = layer.backward(dout)

# 결과 저장

grads = {}

grads['W1'], grads['b1'] = self.layers['Conv1'].dW, self.layers['Conv1'].db

grads['W2'], grads['b2'] = self.layers['Affine1'].dW, self.layers['Affine1'].db

grads['W3'], grads['b3'] = self.layers['Affine2'].dW, self.layers['Affine2'].db

return grads

CNN 시각화하기

1번째 층의 가중치 시각화하기

- 학습 전(왼쪽) 필터는 무작위로 초기화되어 흑백의 정도에 규칙성이 없다. 하지만 학습 후(오른쪽) 필터는 규칙성 있는 이미지가 되었다.

- 규칙성 있는 필터는 에지와 블롭등의 원시적인 정보들을 보고 있다.

층 깊이에 따른 추출 정보 변화

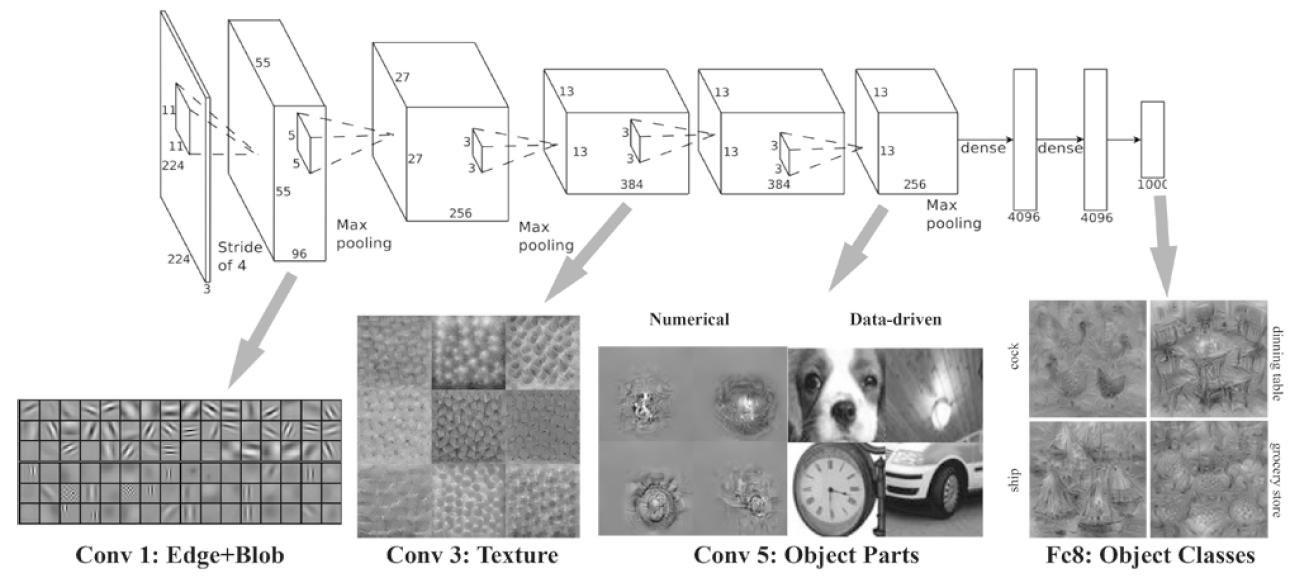

- 위 사진은 AlexNet 네트워크 구조이다.

- 합성곱 계층을 여러 겹 쌓으면, 층이 깊어지면서 더 복잡하고 추상적인 정보가 추출된다.(뉴런이 반응하는 대상이 단순한 모양에서 '고급' 정보로 변화해 사물의 '의미'를 이해하도록 변화한다.)

대표적인 CNN

LeNet

- CNN의 원조이며, 손글씨 숫자를 인식하는 네트워크이다.

- 합성곱 계층과 풀링 계층을 반복하고 마지막으로 완전연결 계층을 거치면서 결과를 출력한다.

- 시그모이드 함수를 사용한다.

- 서브샘플링을 하여 중간 데이터의 크기를 줄인다.

AlexNet

- 딥러닝 열풍을 일으키는데 큰 역할을 한 네트워크이다.

- 활성화 함수로 ReLU를 이용한다.

- LRN이라는 국소적 정규화를 실시하는 계층을 이용한다.

- 드롭아웃을 사용한다.